Dans les coulisses : Comment l’IA suit vraiment vos calories

L’évolution de la reconnaissance alimentaire

Il y a encore peu, reconnaître précisément des aliments à partir de photos relevait du défi impossible. Les premiers systèmes utilisaient des techniques de vision par ordinateur très basiques, capables d’identifier seulement quelques aliments dans des conditions idéales. Un mauvais éclairage ou plusieurs aliments sur l’assiette suffisaient à les tromper.

Le tournant est venu avec l’arrivée des grands modèles de langage multimodaux (LLM) – des IA entraînées sur d’immenses bases de données mêlant textes et images. Ces modèles ne se contentent pas de « voir » votre plat : ils le comprennent dans son contexte, comme le ferait un nutritionniste.

Le saviez-vous ? Les modèles modernes de reconnaissance alimentaire sont entraînés sur des millions d’images de plats du monde entier, ce qui leur permet d’identifier des recettes issues de nombreuses cultures.

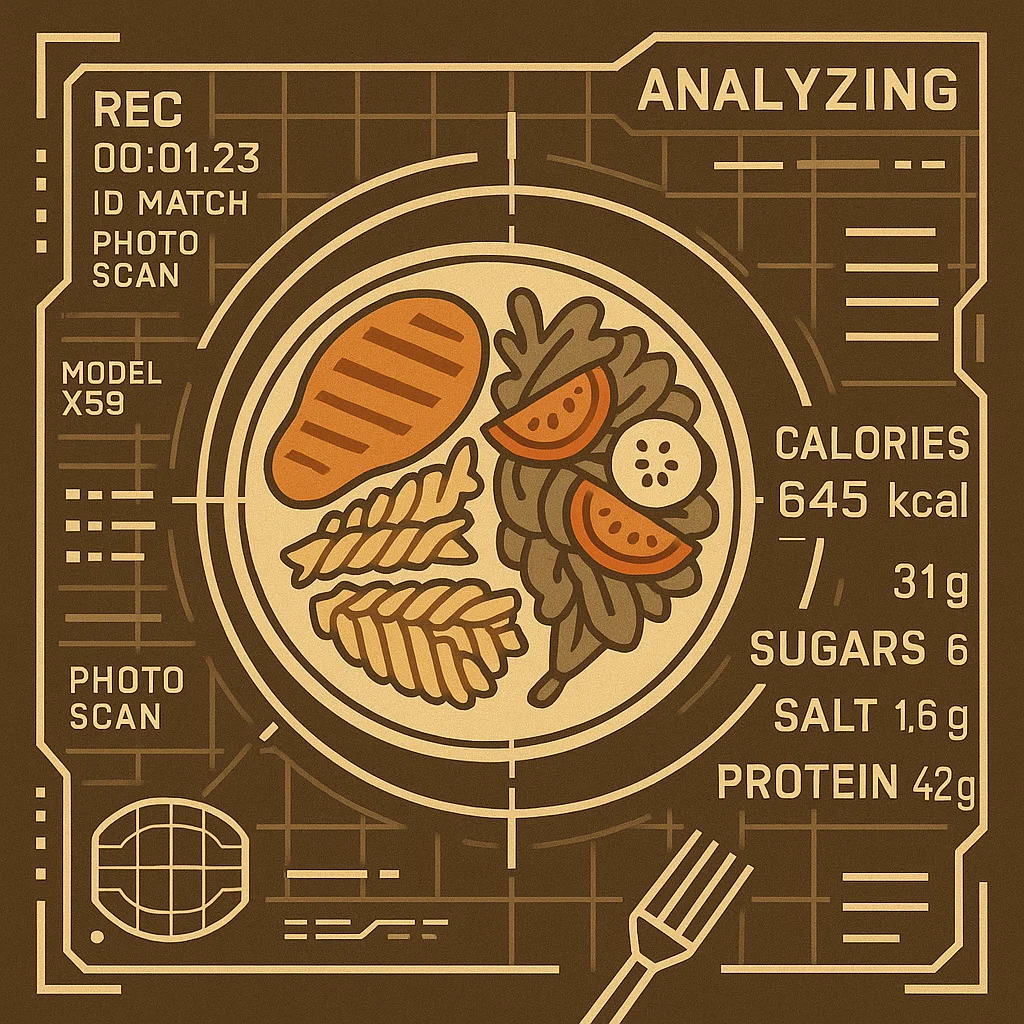

Comment l’IA multimodale « voit » votre repas

Lorsque vous prenez une photo de votre assiette, plusieurs processus sophistiqués s’enclenchent instantanément :

Étape 1 : Analyse de l’image

L’IA traite d’abord les pixels bruts de la photo, identifiant formes, couleurs, textures et relations spatiales. Cela lui permet de distinguer les différents aliments présents.

Étape 2 : Détection des objets

Le modèle segmente l’image en régions et identifie chaque aliment, même s’ils se chevauchent ou sont partiellement cachés. Il fait la différence entre un burrito, un wrap ou une enchilada.

Étape 3 : Reconnaissance des détails

L’IA repère des indices subtils que l’humain ne voit pas toujours : la coloration du pain qui indique du blé complet, la texture d’une viande qui révèle sa cuisson, ou la brillance des légumes qui trahit la présence d’huile.

Étape 4 : Estimation des portions

Grâce à sa compréhension spatiale et à des points de référence, l’IA estime le volume et le poids de chaque aliment. Les systèmes modernes tiennent compte de la perspective et de la profondeur pour des estimations très précises.

Étape 5 : Recherche nutritionnelle

Les aliments identifiés sont comparés à de vastes bases de données nutritionnelles pour déterminer calories, macronutriments et micronutriments selon la portion estimée.

Étape 6 : Raisonnement contextuel

Enfin, le modèle utilise sa connaissance des modes de cuisson, des types de cuisine et des associations courantes pour affiner ses estimations et combler les informations manquantes.

La puissance du raisonnement flou

Ce qui rend l’IA moderne si impressionnante, c’est sa capacité à gérer l’ambiguïté – ce que les ingénieurs appellent le « raisonnement flou ». Contrairement aux logiciels classiques à règles strictes, les grands modèles de langage peuvent :

- Faire des suppositions éclairées quand l’information est incomplète

- Intégrer les indices visuels et vos descriptions textuelles

- S’appuyer sur la connaissance du contexte (ingrédients typiques, recettes…)

- Ajuster leur confiance selon la qualité de l’image

- S’améliorer avec le temps grâce à vos retours et corrections

Ce raisonnement flou ressemble beaucoup à celui d’un expert humain. Un nutritionniste n’a pas besoin d’analyser chimiquement vos pâtes pour savoir qu’elles contiennent des glucides, et il peut estimer la portion sans balance. L’IA atteint enfin ce niveau de compréhension contextuelle.

Vision par ordinateur classique (avant)

- Reconnaît seulement quelques aliments appris

- Difficultés avec les plats mélangés ou complexes

- Nécessite un éclairage et un angle parfaits

- Aucun sens du contexte

- Identification binaire « juste ou faux »

LLM multimodaux (aujourd’hui)

- Reconnaît presque tous les plats, toutes cuisines confondues

- Gère les repas complexes et multi-composants

- Fonctionne dans diverses conditions d’éclairage

- Comprend le contexte et la préparation

- Raisonne par probabilités

Quand le texte rencontre l’image : l’avantage multimodal

La vraie révolution est venue quand l’IA a appris à traiter images et textes ensemble – c’est l’apprentissage multimodal. Cette approche permet à l’IA de comprendre la nourriture d’une façon inédite.

Par exemple, si vous photographiez un bol de soupe et ajoutez « soupe de nouilles au poulet maison », l’IA ne voit pas juste un liquide avec des morceaux flottants : elle comprend que vous mangez une soupe de nouilles au poulet et applique ses connaissances sur les ingrédients typiques, même si tout n’est pas visible.

Cette intégration texte-image crée une « boucle d’information complémentaire » : l’image aide à préciser le texte, et le texte éclaire les éléments visuels ambigus. Résultat : un système bien plus précis et utile qu’un modèle basé uniquement sur l’image.

« Les IA les plus puissantes ne se contentent pas de voir – elles comprennent ce qu’elles observent dans un contexte riche. »

Défis et limites actuels

Même si la reconnaissance alimentaire par IA a fait d’énormes progrès, il reste des limites importantes :

Ces limites rappellent que l’IA doit être vue comme une assistante intelligente, pas une autorité infaillible. Les meilleurs systèmes acceptent l’incertitude et permettent à l’utilisateur d’ajuster les estimations.

Trouver l’équilibre entre précision et simplicité

Le vrai défi de la reconnaissance alimentaire par IA n’est pas d’atteindre la perfection, mais de trouver le bon équilibre entre précision et facilité d’utilisation. Comme nous l’expliquons dans notre article sur la simplicité dans le suivi calorique, un système ultra-précis mais trop complexe sera moins utile qu’un système un peu moins précis mais facile à utiliser au quotidien.

Les IA modernes font ce choix :

- La rapidité plutôt que l’analyse exhaustive – Résultats en quelques secondes

- L’intuitif plutôt que la technicité – Une simple photo au lieu d’un long questionnaire

- La régularité plutôt que la perfection occasionnelle – Mieux vaut suivre ses repas tous les jours que viser la précision absolue une fois par semaine

En résumé : le meilleur outil nutritionnel, c’est celui que vous utiliserez vraiment chaque jour.

L’avenir de la reconnaissance alimentaire par IA

Quelles sont les prochaines étapes pour cette technologie en pleine évolution ? Plusieurs avancées prometteuses arrivent :

Modélisation nutritionnelle personnalisée

Les IA du futur apprendront votre métabolisme et ajusteront les estimations nutritionnelles selon la façon dont votre corps réagit, grâce à des capteurs comme les lecteurs de glucose en continu.

Estimation avancée du volume en 3D

Les nouvelles techniques de vision par ordinateur utiliseront la profondeur ou plusieurs angles pour modéliser vos plats en 3D, améliorant nettement l’estimation des portions sans matériel spécial.

Remontée nutritionnelle dans le temps

Les IA pourront déduire ce que vous avez mangé à partir de photos prises plus tard, en s’appuyant sur des marqueurs métaboliques, pour un suivi rétroactif même si vous oubliez de tout enregistrer sur le moment.

Intégration à la réalité augmentée

Les lunettes AR afficheront en temps réel les informations nutritionnelles, vous aidant à faire les bons choix avant même de manger, sans avoir à prendre de photo.

L’humain reste au cœur du suivi nutritionnel

Malgré ces avancées, l’humain reste essentiel. L’IA doit être vue comme une assistante qui simplifie la vie et guide, pas comme un substitut au jugement humain.

Les meilleurs outils de demain combineront IA de pointe et expertise humaine. Ils sauront quand proposer des estimations précises et quand privilégier l’approximation pour préserver la relation saine à l’alimentation.

Au final, la plus grande contribution de l’IA n’est pas la précision, mais l’accessibilité. En rendant le suivi nutritionnel simple et accessible à tous, ces technologies démocratisent la connaissance alimentaire et aident chacun à adopter une relation plus saine avec la nourriture.

Testez le suivi nutritionnel par IA ! Prenez en photo votre prochain repas et voyez la précision de l’analyse Crumpeat – sans balance ni verre doseur.

Découvrez pourquoi la simplicité est essentielle dans notre article sur l’échec des applis de suivi calorique trop complexes.