Bakom kulisserna: Så fungerar AI-kaloriräkning på riktigt

Matigenkänningens utveckling

För bara några år sedan ansågs korrekt matigenkänning från bilder vara nästintill omöjligt. Tidiga system byggde på enkla datorseendetekniker som bara kunde identifiera ett begränsat antal livsmedel under perfekta förhållanden. Om ljuset var dåligt eller flera saker låg på tallriken misslyckades systemen ofta helt.

Vändningen kom med utvecklingen av avancerade multimodala stora språkmodeller (LLM) – AI-system tränade på enorma mängder text och bilder. Dessa modeller "ser" inte bara din mat, de förstår den i sitt sammanhang, ungefär som en mänsklig dietist.

Visste du? Moderna matigenkänningsmodeller tränas på miljontals matbilder från hela världen, vilket gör att de kan känna igen rätter från olika kök och kulturer.

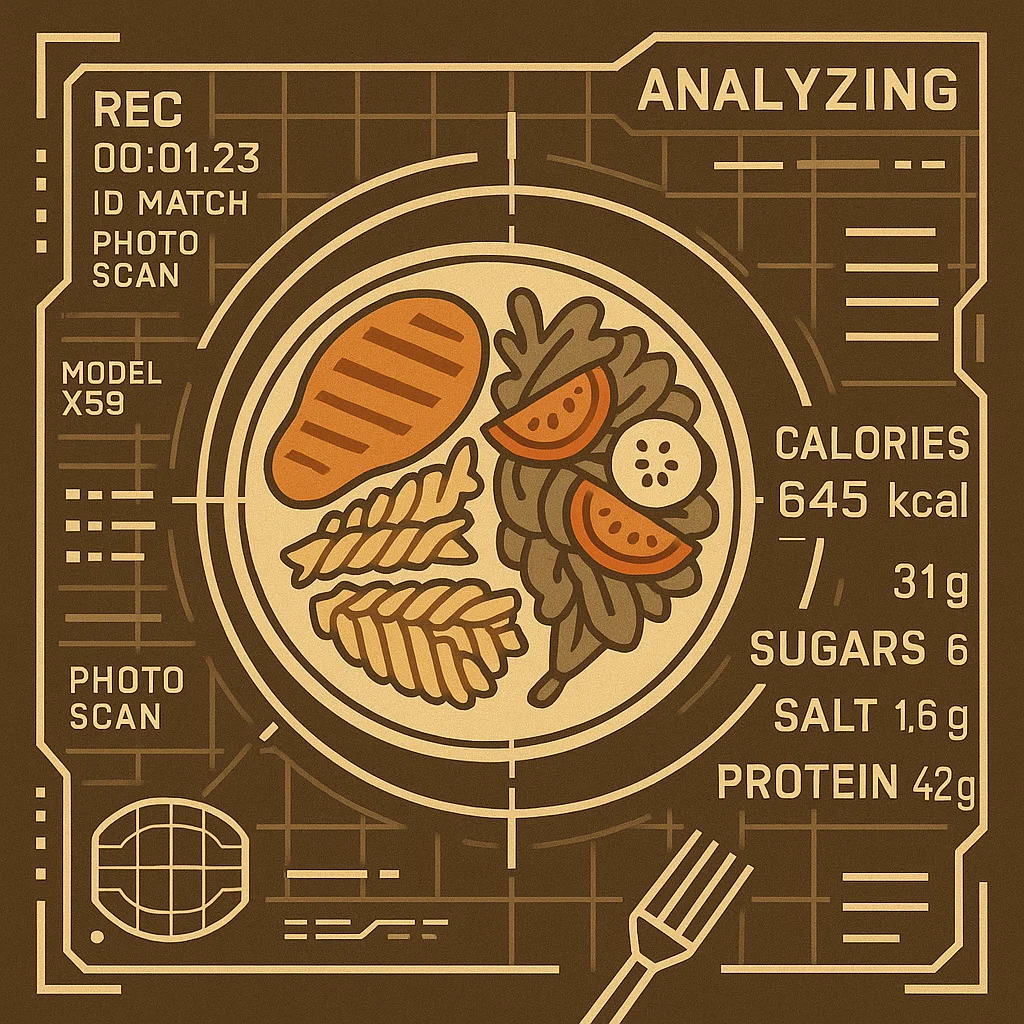

Så "ser" multimodal AI din mat

När du tar ett foto på din måltid sker flera avancerade processer nästan omedelbart:

Steg 1: Bildanalys

AI:n bearbetar först bildens pixlar och identifierar former, färger, texturer och rumsliga relationer. Det hjälper den att skilja mellan olika livsmedel på tallriken.

Steg 2: Objektigenkänning

Modellen delar upp bilden i regioner och identifierar enskilda livsmedel, även om de överlappar eller är delvis dolda. Den kan skilja på en burrito, en wrap och en enchilada.

Steg 3: Detaljigenkänning

AI:n letar efter subtila visuella ledtrådar som människor ofta missar – brödets bryningsmönster som visar att det är fullkorn, köttets textur som avslöjar tillagningsmetod, eller glansen på grönsaker som tyder på olja.

Steg 4: Portionsuppskattning

Med hjälp av rumslig förståelse och referenspunkter uppskattar AI:n volym och vikt på varje del. Moderna system kan ta hänsyn till perspektiv och djup för att göra förvånansvärt exakta uppskattningar.

Steg 5: Näringsdatabas

De identifierade livsmedlen matchas mot omfattande näringsdatabaser för att räkna ut kalorier, makro- och mikronäringsämnen baserat på uppskattad portion.

Steg 6: Kontextuell tolkning

Slutligen använder modellen sin förståelse för tillagningsmetoder, kökstyper och vanliga kombinationer för att fylla i saknad information och förfina sina uppskattningar.

Fuzzy reasoning – AI:s osäkra gissningar

Det som gör modern AI-matigenkänning så imponerande är dess förmåga att hantera osäkerhet – det ingenjörer kallar "fuzzy reasoning". Till skillnad från traditionell mjukvara med strikta regler kan stora språkmodeller:

- Göra kvalificerade gissningar när information saknas

- Integrera visuella ledtrådar med textbeskrivningar du anger

- Dra nytta av kontextuell kunskap om typiska ingredienser i olika rätter

- Justera säkerhetsnivåer beroende på bildkvalitet och tydlighet

- Bli bättre över tid genom att lära av användarfeedback och rättelser

Denna "fuzzy reasoning" liknar hur mänskliga experter arbetar. En dietist behöver inte kemiskt analysera din pasta för att veta att den innehåller kolhydrater, och kan uppskatta portioner utan att väga tallriken. AI har nu nått en liknande nivå av kontextuell förståelse.

Traditionellt datorseende (Förr)

- Kände bara igen specifika tränade livsmedel

- Hade svårt med blandad mat och komplexa rätter

- Krävde perfekt ljus och vinkel

- Ingen kontextuell förståelse

- Binär "rätt eller fel"-identifiering

Multimodala LLM:er (Nu)

- Känner igen nästan all mat från alla kök

- Hanterar komplexa, mångsidiga måltider

- Fungerar i olika ljusförhållanden

- Förstår kontext och tillagningsmetoder

- Gör sannolikhetsbaserade bedömningar

När text möter bild: Den multimodala fördelen

Det verkliga genombrottet kom när AI-modeller lärde sig att bearbeta både bilder och text – så kallad multimodal inlärning. Det gör att AI:n kan förstå mat på sätt som tidigare var omöjliga.

Om du till exempel tar en bild på en soppa och skriver "hemmagjord kycklingsoppa" ser AI:n inte bara vätska med flytande objekt – den förstår att du äter kycklingsoppa och kan använda sin kunskap om typiska ingredienser och näringsinnehåll, även om vissa delar inte syns tydligt på bilden.

Denna integration av text och bild skapar det forskare kallar en "kompletterande informationsslinga". Bilddata hjälper till att tolka texten, och texten hjälper till att tolka tvetydiga visuella element. Resultatet är ett system som är mycket mer träffsäkert och användbart än ett som bara förlitar sig på bilder.

"De mest kraftfulla AI-systemen ser inte bara vad som finns där – de förstår vad de tittar på i ett rikt kontextuellt ramverk."

Utmaningar och begränsningar

Trots stora framsteg finns det fortfarande begränsningar:

Dessa begränsningar visar varför AI-matigenkänning bäst ses som en smart assistent, inte en ofelbar auktoritet. De bästa systemen erkänner osäkerhet och låter användaren justera uppskattningarna.

Balans mellan noggrannhet och användarvänlighet

Den stora utmaningen är inte att nå perfekt noggrannhet – utan att hitta rätt balans mellan precision och användbarhet. Som vi diskuterade i vår artikel om enkelhet i kaloriräkning ger ett system som är 99% korrekt men för krångligt att använda mindre värde än ett som är 90% korrekt men passar in i vardagen.

Moderna AI-lösningar gör medvetet denna avvägning och prioriterar:

- Snabbhet framför total analys – Resultat på sekunder istället för minuter

- Intuitiv användning framför teknisk precision – Enkelt foto istället för långa frågeformulär

- Konsekvens framför tillfällig perfektion – Uppmuntrar regelbunden spårning istället för sporadisk exakthet

Den viktigaste sanningen: Den mest exakta näringsappen är den du faktiskt använder varje dag.

Framtiden för AI-matigenkänning

Vad väntar härnäst för denna snabbt utvecklande teknik? Några spännande trender är på väg:

Personlig näringsmodellering

Framtidens AI kommer att lära sig din personliga ämnesomsättning och justera näringsuppskattningar utifrån hur just din kropp reagerar på olika livsmedel, mätt via kontinuerliga glukosmätare och andra biometriska sensorer.

Avancerad 3D-volymuppskattning

Nya datorseendetekniker kommer använda djupsensorer eller flera vinklar för att skapa 3D-modeller av din mat, vilket ger mycket bättre portionsuppskattningar utan specialutrustning.

Näringsmässig "tidsresa"

AI-system kommer kunna dra slutsatser om vad du ätit utifrån foton tagna flera timmar senare, baserat på metabola markörer – så du kan logga i efterhand även om du glömde i stunden.

AR-integrering

AR-glasögon kommer visa näringsinformation i realtid när du tittar på mat, så du kan fatta smarta beslut innan du äter – utan att behöva ta ett foto.

Människan är fortfarande viktigast

Trots all teknik är den mänskliga faktorn avgörande för näringsspårning. AI ska ses som en smart assistent som minskar friktion och ger vägledning – inte som en ersättning för mänskligt omdöme.

De mest effektiva systemen i framtiden kommer kombinera toppmodern AI med mänsklig expertis och intuition. De kommer veta när exakta uppskattningar behövs och när ungefärliga värden är bättre. De förstår att perfekt spårning som skapar stress är sämre än imperfekt spårning som främjar en sund relation till mat.

I slutändan är AI:s största bidrag till näringsspårning inte ökad exakthet – utan ökad tillgänglighet. Genom att göra matloggning så enkelt att alla kan hålla ut, demokratiserar tekniken näringsmedvetenhet och hjälper miljontals människor till en sundare relation till mat.

Testa AI-driven näringsspårning själv. Ta ett foto på din nästa måltid och se hur träffsäkert Crumpeat kan analysera den – inga måttsatser eller våg behövs.

Läs mer om varför enkelhet är viktigt i vår artikel om varför de flesta kaloriräkningsappar misslyckas på grund av onödig komplexitet.